本文目录一览:

- 1、人工智能伦理的意思

- 2、人工智能伦理问题包括

- 3、机器人伦理

人工智能伦理的意思

1、人工智能伦理(AI Ethics)是探讨人工智能技术发展和应用中伦理问题的学科,旨在确保AI系统的设计、开发、部署和使用符合道德标准和社会责任,促进公平、透明和负责任的应用。

2、人工智能伦理学是探讨人工智能技术发展和应用中伦理问题的学科,旨在确保AI系统的设计、开发和部署符合道德标准与社会责任,推动其公平、透明且负责任的使用。核心目标与关注点人工智能伦理学聚焦于AI技术全生命周期的伦理规范,涵盖设计、开发、部署等环节。

3、人工智能伦理:关注人工智能技术本身的伦理问题,如人工智能的道德、责任、透明度、隐私等问题。应用伦理:关注人工智能技术在具体应用场景中的伦理问题,如人工智能在医疗、金融、安全等领域的应用所带来的伦理问题。

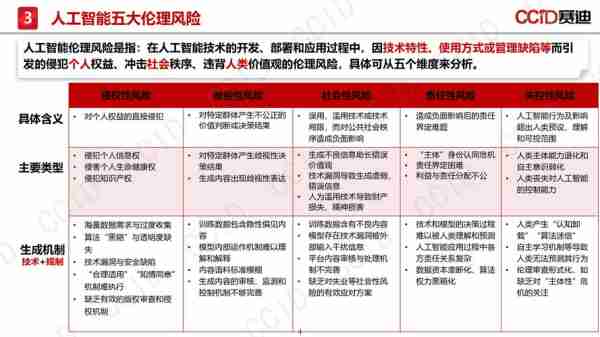

4、人工智能的伦理风险是指在人工智能技术的研发、应用过程中,可能对人类价值观、道德规范和法律法规产生的负面影响。这些风险主要包括以下几个方面:失控性风险 定义:指人工智能的行为与影响超出预设、理解、可控的范围,对社会价值等方面产生负面影响的风险。

5、人工智能正经历从原则到实践的“伦理转向”,即通过将抽象伦理原则嵌入技术研发与应用全生命周期,推动负责任、安全可信的人工智能发展。

人工智能伦理问题包括

1、人工智能伦理问题主要包括人类主体地位挑战、技术与社会风险、人机关系异化和伦理治理滞后四类。人类主体地位挑战:人工智能的发展可能会使人类的科学精神减弱,导致劳动异化,让人类的主体地位逐渐边缘化。同时,人机关系变得复杂,这在存在论层面引发了伦理困境。技术与社会风险:数据隐私方面,教育、医疗等领域存在敏感信息被滥用的情况。

2、人工智能带来的伦理问题主要包括失控风险、恶意使用、适应性风险、认知风险等,其应对措施包括建立普遍的人工智能伦理规范、推动终身学习以及鼓励创新和创意领域的发展。人工智能带来的伦理问题 失控风险:人工智能系统的自主决策能力可能导致其行为超出人类控制范围,从而引发安全风险。

3、人工智能伦理问题主要包括以下核心方面:人类主体地位与价值挑战主体边缘化风险方面,人工智能可能削弱人类科学精神,导致劳动异化,威胁人类在社会中的主导地位;人机关系异化方面,过度依赖AI会引发情感疏离、成瘾性依恋,长远或导致人机关系失衡。

4、人工智能的伦理问题主要包括人类主体地位挑战、技术应用风险、责任与权利困境、社会伦理冲击和治理与规范滞后等方面。人类主体地位挑战:人工智能可能会使人类的科学精神减弱,劳动出现异化,主体地位逐渐边缘化。人机关系的紧张也引发了人们对人类独特性,如意识和情感的担忧。

5、隐私问题:人工智能的发展伴随着大量数据的收集、存储与分析,这加剧了对个人数据隐私和数据安全的担忧。 道德和价值观问题:人工智能系统在决策过程中可能无法完全遵循公正和公平的原则,尤其是在贷款审批、犯罪侦查等领域。

机器人伦理

1、机器人伦理是研究机器人在设计、制造、应用过程中涉及的伦理道德问题,涵盖机器人权利、人工智能伦理、人机关系及责任界定等方面,其核心在于平衡技术进步与人类社会的道德、法律及安全需求。

2、人类责任主导:如医疗机器人伦理准则要求开发者对算法偏见负责;机器伦理内化:如波士顿动力机器人通过强化学习规避伤害人类行为。这种“人类-机器”伦理互动,标志着伦理研究从“人类中心主义”向“技术共生主义”转型。结语机器人伦理难题的本质,是技术理性与人文价值的碰撞。

3、AI:虽然LLM模型可以胜任多种任务,但它的训练和使用方式与人类不同。它按照预设的算法和数据进行训练,在为不同用户服务时,通过“记忆替换”来模拟个性化服务,缺乏人类那种实时的、自主的网络训练和工作记忆获取能力。